IBM Đề Xuất Giải Pháp Biến Lưu Trữ Doanh Nghiệp Thành Công Cụ Chuẩn Bị Dữ Liệu AI Mạnh Mẽ

IBM Đề Xuất Giải Pháp Biến Lưu Trữ Doanh Nghiệp Thành Công Cụ Chuẩn Bị Dữ Liệu AI Mạnh Mẽ

Một hướng dẫn Redbook của IBM đã phác thảo cách tích hợp các giải pháp lưu trữ của hãng như Storage Scale ECE, IBM Fusion và Content-Aware Storage (CAS) với Nền tảng Dữ liệu AI của Nvidia, nhằm tạo ra một công cụ chuẩn bị AI chủ động, liên tục xử lý dữ liệu phi cấu trúc và biến chúng thành định dạng sẵn sàng cho AI.

IBM và Nvidia Hợp Tác Tạo Động Cơ Chuẩn Bị Dữ Liệu AI

Một hướng dẫn Redbook mới của IBM đã trình bày chi tiết cách tích hợp các giải pháp lưu trữ của hãng, bao gồm Storage Scale Erasure Coding Edition (ECE), IBM Fusion và Content-Aware Storage (CAS), với Nền tảng Dữ liệu AI (AIDP) của Nvidia. Mục tiêu là xây dựng một “động cơ chuẩn bị AI chủ động” có khả năng liên tục xử lý dữ liệu phi cấu trúc, biến chúng thành định dạng sẵn sàng cho AI thông qua các quy trình phân đoạn ngữ nghĩa (semantic chunking), vector hóa và lập chỉ mục được tăng tốc bằng GPU.

Vào tháng 3 năm ngoái, IBM đã bổ sung tính năng nhận biết nội dung (Content Awareness) vào Storage Scale (CAS) để nâng cao khả năng tạo sinh có tăng cường truy xuất (RAG), dựa trên kiến trúc AI-Q của Nvidia và microservice NeMo Retriever. Cùng thời điểm đó, IBM cũng công bố Storage Scale sẽ hỗ trợ thiết kế tham chiếu của Nền tảng Dữ liệu AI của Nvidia. IBM cho biết các tiện ích nhận biết nội dung của Storage Scale sẽ được tích hợp vào bản cập nhật tiếp theo của IBM Fusion, dự kiến ra mắt rộng rãi vào quý 2 năm 2025.

Thách Thức Dữ Liệu Phi Cấu Trúc Trong AI

IBM chỉ ra rằng một thách thức lớn đối với các hệ thống AI tác nhân (agentic AI) là việc chuẩn bị các kho dữ liệu doanh nghiệp khổng lồ. Ước tính khoảng 80 đến 90 phần trăm dữ liệu này tồn tại dưới dạng tài liệu phi cấu trúc, tệp đa phương tiện và các định dạng không chuẩn hóa khác, gây khó khăn cho việc tiêu thụ bởi các hệ thống AI.

Nền tảng Dữ liệu AI của Nvidia (AIDP) được thiết kế để “biến đổi cơ sở hạ tầng lưu trữ truyền thống từ các thùng chứa dữ liệu thụ động thành các động cơ chuẩn bị AI chủ động”. Bằng cách tích hợp khả năng tăng tốc GPU trực tiếp vào đường dẫn dữ liệu, Nvidia AIDP thực hiện các hoạt động phức tạp cần thiết để biến dữ liệu phi cấu trúc thành định dạng sẵn sàng cho AI – bao gồm phân đoạn ngữ nghĩa, vector hóa và đồng bộ hóa liên tục – như các quy trình nền tàng ẩn đối với người dùng cuối.

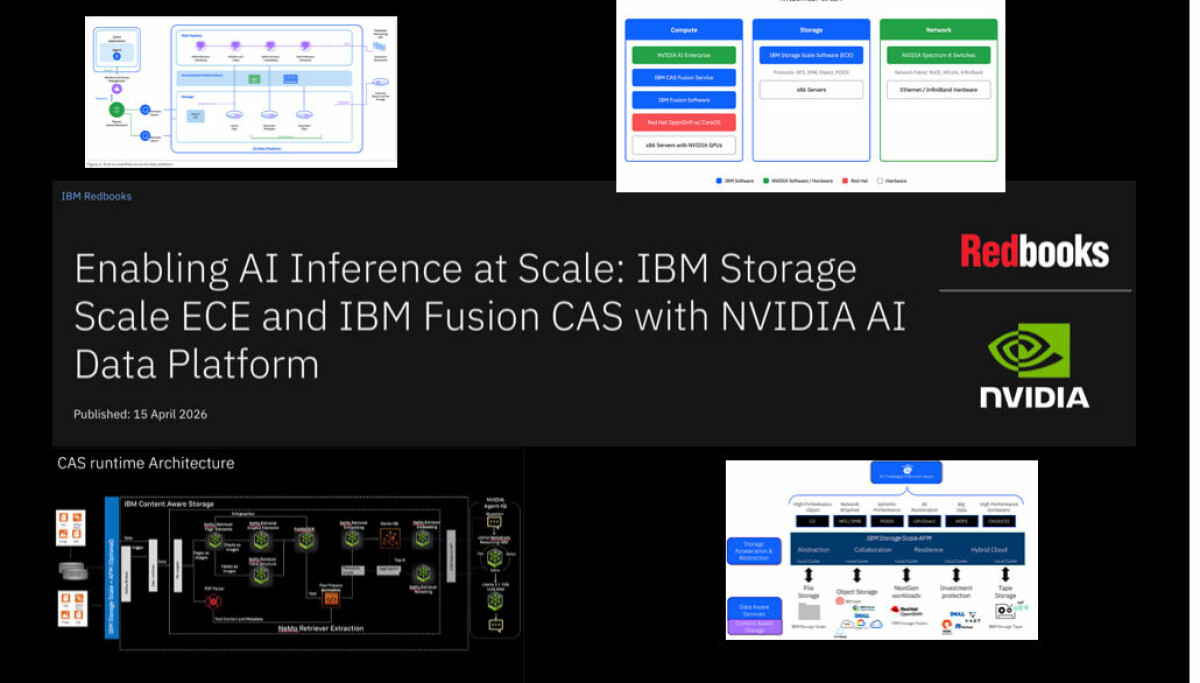

Các Thành Phần Của IBM Trong Hệ Thống AIDP

Redbook của IBM phác thảo cách triển khai Storage Scale ECE, IBM Fusion và IBM Content-Aware Storage (CAS) làm lớp lưu trữ cùng với Nvidia AIDP để hiện thực hóa mục tiêu này. Dưới đây là vị trí của chúng trong một hệ thống AIDP:

IBM Storage Scale ECE: Lưu Trữ Hiệu Năng Cao Cho AI

IBM mô tả Storage Scale ECE là giải pháp lưu trữ được định nghĩa bằng phần mềm, nổi bật với hệ thống tệp song song hiệu suất cao được thiết kế để loại bỏ các nút thắt cổ chai về I/O dữ liệu. Nó có thể liên tục cung cấp dữ liệu cho GPU để thực hiện suy luận thời gian thực, quy trình làm việc RAG và các ứng dụng AI tác nhân. Kiến trúc Global Data Platform của Storage Scale trình bày các nguồn dữ liệu phân tán trong một không gian tên duy nhất cho GPU của Nvidia, bất kể dữ liệu nằm nguyên bản trong Storage Scale hay được truy cập từ bộ nhớ ngoài thông qua Active File Management (AFM).

Hệ thống tệp song song của Storage Scale cung cấp quyền truy cập dữ liệu băng thông cao, đồng thời cho các khối lượng công việc AIDP. Nhiều GPU có thể truy xuất đồng thời các vector nhúng (vector embeddings), các đoạn tài liệu (document chunks) và nội dung cơ sở tri thức mà không gặp phải tranh chấp I/O, cho phép các đường ống RAG mở rộng tuyến tính khi tài nguyên tính toán tăng lên. Storage Scale ECE hỗ trợ POSIX cho quyền truy cập hệ thống tệp truyền thống, S3 cho khả năng tương thích lưu trữ đối tượng, NFS và SMB để chia sẻ tệp mạng, và CSI (Container Storage Interface) cho môi trường Kubernetes. Nó cũng hỗ trợ GPUDirect Storage (GDS) của Nvidia, với đường dẫn truy cập bộ nhớ trực tiếp (DMA) giữa hệ thống tệp Storage Scale và bộ nhớ GPU.

IBM Storage Scale Active File Management (AFM): Nền Tảng Dữ Liệu Toàn Cầu Thống Nhất

AFM là một tính năng bộ nhớ đệm phân tán, thiết lập một nền tảng và không gian tên dữ liệu toàn cầu, thống nhất trên các cụm IBM Storage Scale phân tán về mặt địa lý và các nguồn lưu trữ đối tượng đám mây, NFS của bên thứ ba. Bằng cách cho phép một cụm cục bộ (gọi là “cache”) tìm nạp và lưu trữ các bản sao của dữ liệu từ xa (gọi là “home”), AFM giúp che giấu độ trễ mạng và cung cấp quyền truy cập dữ liệu tốc độ cao, cục bộ cho người dùng từ xa và các ứng dụng AI.

IBM Fusion CAS: Tối Ưu Hóa Quy Trình RAG

Fusion CAS cho phép nhập dữ liệu không sao chép (zero-copy ingestion) và cập nhật cơ sở dữ liệu vector tăng dần từ các nguồn phi cấu trúc, giảm thiểu việc di chuyển dữ liệu, độ trễ và sự phức tạp trong vận hành. Trong một triển khai AIDP, Fusion CAS tái cấu trúc đường ống tạo sinh có tăng cường truy xuất (RAG) bằng cách thực hiện các bước chuẩn bị dữ liệu quan trọng ở lớp lưu trữ, giúp giảm thiểu độ trễ suy luận AI và chi phí tài nguyên.

Quy trình làm việc RAG của IBM Fusion CAS trong Nvidia AIDP hoạt động qua hai giai đoạn: luồng nhập/chuẩn bị dữ liệu và luồng truy xuất/truy vấn. Nó cung cấp một quy trình tự động và liên tục để lập chỉ mục và vector hóa dữ liệu khi chúng đến. Nội dung được trích xuất sẽ được phân đoạn và chuyển đổi thành các vector chiều cao (embeddings) bằng cách sử dụng microservice Nvidia embedding NIM. Hệ thống lưu trữ các vector này trong một cơ sở dữ liệu vector do Fusion CAS quản lý trên Storage Scale ECE.

Khi người dùng hoặc tác nhân AI đặt câu hỏi, Fusion CAS tăng tốc và bảo mật việc truy xuất ngữ cảnh. Khả năng xử lý siêu dữ liệu được tăng tốc bằng phần cứng của Fusion CAS và các bản cập nhật tăng dần theo thời gian thực giúp giảm độ trễ cho suy luận AI.

Redbook này không đề cập đến khu vực bộ nhớ đệm KV (KV cache). IBM kỳ vọng một phiên bản cập nhật sẽ bao gồm bộ nhớ đệm KV với một thiết bị bộ nhớ ngữ cảnh và phần mềm được thêm vào sơ đồ này.

Nguon tham khao

IBM lays out recipe for turning enterprise storage into an AI prep engine – blocksandfiles.com

IBM and Nvidia Collaborate on AI Data Preparation Engine

A new IBM Redbook guide illustrates how to integrate IBM’s storage solutions, including Storage Scale Erasure Coding Edition (ECE), IBM Fusion, and Content-Aware Storage (CAS), with Nvidia’s AI Data Platform (AIDP). The goal is to establish an “active AI preparation engine” that continuously processes unstructured data, making it AI-ready through GPU-accelerated semantic chunking, vectorization, and indexing.

Last March, IBM enhanced Storage Scale with content awareness (CAS) to boost its retrieval-augmented generation (RAG) capabilities, leveraging Nvidia’s AI-Q blueprint and NeMo Retriever microservice. Concurrently, IBM announced Storage Scale’s support for Nvidia’s AI Data Platform reference design. IBM stated that Storage Scale’s content awareness features would be embedded in the next IBM Fusion update, generally available in Q2 2025.

Addressing Unstructured Data Challenges for AI

IBM highlights that a significant challenge for agentic AI systems is preparing vast enterprise data repositories, with an estimated 80 to 90 percent existing as unstructured documents, multimedia files, and other non-standardized formats, making them difficult for AI systems to consume.

The Nvidia AI Data Platform (AIDP) is designed to “transform traditional storage infrastructure from passive data containers into active AI preparation engines.” By embedding GPU acceleration directly into the data path, Nvidia AIDP performs complex operations—including semantic chunking, vectorization, and continuous synchronization—as background processes invisible to end users, making unstructured data AI-ready.

IBM Components within the AIDP System

The IBM Redbook outlines the implementation of Storage Scale ECE, IBM Fusion, and IBM Content-Aware Storage (CAS) as a storage layer with Nvidia AIDP to achieve this. Here’s how they are positioned within an AIDP system:

IBM Storage Scale ECE: High-Performance Storage for AI

IBM describes Storage Scale ECE as software-defined storage featuring a high-performance parallel file system engineered to eliminate data I/O bottlenecks. It ensures GPUs are continuously fed with data for real-time inference, RAG workflows, and agentic AI applications. Storage Scale’s Global Data Platform architecture presents dispersed data sources in a single namespace to Nvidia GPUs, whether data resides natively in Storage Scale or is accessed from external storage via Active File Management (AFM).

Its parallel file system provides concurrent, high-bandwidth data access for AIDP workloads. Multiple GPUs can simultaneously retrieve vector embeddings, document chunks, and knowledge base content without I/O contention, allowing RAG pipelines to scale linearly with compute resources. Storage Scale ECE supports POSIX, S3, NFS, SMB, and CSI for Kubernetes environments, along with Nvidia’s GPUDirect Storage (GDS) for direct memory access (DMA) between the file system and GPU memory.

IBM Storage Scale Active File Management (AFM): Unified Global Data Platform

AFM is a distributed caching feature that creates a global, unified data platform and namespace across geographically dispersed IBM Storage Scale clusters and third-party NFS and cloud object storage. By enabling a local cluster (the “cache”) to fetch and store copies of remote data (the “home”), AFM masks network latency and delivers high-speed, local data access for remote users and AI applications.

IBM Fusion CAS: Optimizing the RAG Pipeline

Fusion CAS facilitates zero-copy ingestion and incremental vector database updates from unstructured sources, reducing data movement, latency, and operational complexity. In an AIDP implementation, Fusion CAS rearchitects the retrieval-augmented generation (RAG) pipeline by executing critical data-preparation steps within the storage layer, thereby minimizing AI inference latency and resource costs.

The IBM Fusion CAS RAG workflow within Nvidia AIDP operates in two phases: data ingestion/preparation and retrieval/query. It provides a continuous, automated process to index and vectorize incoming data. Extracted content is chunked and converted into high-dimensional vectors (embeddings) using an Nvidia embedding NIM microservice. These vectors are stored in a Fusion CAS-managed vector database on Storage Scale ECE.

When a user or AI agent queries, Fusion CAS accelerates and secures context retrieval. Its hardware-accelerated metadata processing and real-time incremental updates translate to lower latency for AI inference.

This Redbook does not cover the KV cache area, but an updated version is expected to incorporate KV caching with a context memory appliance and software.

Reference

IBM lays out recipe for turning enterprise storage into an AI prep engine – blocksandfiles.com