Hitachi, IBM, Nutanix, Seagate đang định hình lại AI Storage như thế nào?

Tại NVIDIA GTC 2026, một thực tế không thể phủ nhận đã xuất hiện: NVIDIA không còn chỉ là nhà sản xuất GPU, mà đã trở thành “trung tâm hấp dẫn” của toàn bộ hệ sinh thái AI.

Các vendor storage lớn như Hitachi, IBM, Nutanix hay Seagate giờ đây không còn phát triển độc lập, mà đang dịch chuyển chiến lược để xoay quanh kiến trúc, phần mềm và roadmap của NVIDIA.

Trong kỷ nguyên AI, ai đứng gần NVIDIA hơn – người đó có lợi thế.

Hitachi Vantara: Xây dựng nền tảng AI-native từ storage

Giải pháp Hitachi iQ của Hitachi Vantara là một danh mục phần cứng và phần mềm được thiết kế nhằm giúp doanh nghiệp triển khai và vận hành hạ tầng AI. Nền tảng này được xây dựng trên hệ thống lưu trữ Virtual Storage Platform One (VSP One), tích hợp khả năng tính toán tăng tốc, mạng và lưu trữ trong một kiến trúc hạ tầng đã được kiểm chứng. Đồng thời, Hitachi iQ còn hỗ trợ bộ phần mềm HMAX, mang AI vào các hệ thống hạ tầng quan trọng của xã hội.

Hiện tại, Hitachi iQ đã hỗ trợ các dòng GPU mới nhất từ NVIDIA, bao gồm:

-

GPU Blackwell (làm mát bằng không khí)

-

GPU Blackwell Ultra (hỗ trợ cả làm mát bằng không khí và chất lỏng)

-

Hệ thống dựa trên kiến trúc Nvidia MGX với tối đa 4 GPU RTX PRO 6000 Blackwell Server Edition

Ngoài ra, Hitachi iQ cũng có kế hoạch hỗ trợ GPU RTX PRO 4500 Blackwell Server Edition vừa được công bố.

Hitachi Vantara sẽ tiếp tục hỗ trợ kiến trúc tham chiếu STX của NVIDIA để phát triển các hệ thống lưu trữ “AI-native”, vận hành trên nền tảng GPU Vera Rubin, DPU BlueField-4 và mạng Spectrum-X, kết hợp với bộ phần mềm AI của hãng.

Phần mềm Hitachi iQ Studio được xây dựng dựa trên thiết kế tham chiếu AI Data Platform của NVIDIA, cung cấp các blueprint AI mở rộng cùng khả năng phối hợp đa tác nhân (multi-agent). Các blueprint mới định nghĩa rõ vai trò của từng agent, bao gồm:

-

Worker agents: thực thi các tác vụ

-

Supervisor agents: điều phối workflow đa tác nhân và thích ứng dựa trên kết quả

Hitachi iQ Studio cũng mở rộng hỗ trợ các mô hình Nemotron – dòng mô hình ngôn ngữ lớn (LLM) được thiết kế cho các hệ thống AI agentic nâng cao có khả năng sử dụng công cụ. Đồng thời, nền tảng này còn giới thiệu khả năng “time machine”, cho phép hệ thống AI truy xuất và phân tích dữ liệu lịch sử. Khả năng “nhận thức theo thời gian” này giúp tăng tính minh bạch (explainability) và đặc biệt phù hợp với các doanh nghiệp cần dựa vào dữ liệu dài hạn để ra quyết định.

Ngoài ra, Hitachi iQ Studio đã được tích hợp chặt chẽ hơn với Hammerspace nhằm tối ưu việc truy cập dữ liệu cho các workflow AI sử dụng agent. Với khả năng này, dữ liệu được quản lý bởi Hammerspace có thể được truy cập trực tiếp trong Hitachi iQ Studio thông qua Model Context Protocol (MCP) – một chuẩn mở cho phép các hệ thống AI kết nối an toàn tới các nguồn dữ liệu bên ngoài.

Nhận thêm thông tin tại đây

IBM: Tăng tốc dữ liệu doanh nghiệp bằng GPU

IBM đã đưa ra bốn điểm chính về việc hợp tác với NVIDIA:

Tăng tốc phân tích dữ liệu có cấu trúc:

Việc tích hợp mã nguồn mở giữa Nvidia cuDF và engine SQL Presto của IBM watsonx.data giúp tăng tốc đáng kể việc thực thi truy vấn trên các tập dữ liệu lớn. Để kiểm chứng, IBM và NVIDIA đã áp dụng watsonx.data tăng tốc bằng GPU vào hệ thống dữ liệu Order-to-Cash của Nestlé. Kết quả cho thấy thời gian truy vấn giảm từ 15 phút xuống còn 3 phút, giúp tiết kiệm 83% chi phí và cải thiện hiệu năng/chi phí lên tới 30 lần.

Khai phá toàn bộ giá trị dữ liệu doanh nghiệp:

Các doanh nghiệp đang giải quyết bài toán dữ liệu phi cấu trúc bằng cách sử dụng Docling của IBM kết hợp với các mô hình Nemotron mã nguồn mở từ NVIDIA. Giải pháp này cho phép trích xuất tài liệu thông minh ở quy mô lớn trong môi trường doanh nghiệp.

Tối ưu hạ tầng:

NVIDIA hiện đang sử dụng 10PB hệ thống Storage Scale System 6000 của IBM cho các engine phân tích AI-native. Đối với các ngành yêu cầu cao về chủ quyền dữ liệu, IBM và NVIDIA cũng đang nghiên cứu tích hợp IBM Sovereign Core với hạ tầng NVIDIA và các mô hình Nemotron.

Phát triển AI stack doanh nghiệp:

IBM đang cung cấp GPU Blackwell Ultra trên IBM Cloud cho các workload huấn luyện quy mô lớn, inference hiệu năng cao và các tác vụ suy luận AI. Công nghệ này cũng sẽ được tích hợp trong Red Hat AI Factory cùng với hạ tầng NVIDIA và các máy chủ VPC. Đồng thời, IBM Consulting có kế hoạch đưa Red Hat AI Factory tích hợp NVIDIA đến khách hàng thông qua IBM Consulting Advantage.

Nutanix: Đưa Agentic AI vào hạ tầng doanh nghiệp

Nutanix đã công bố Nutanix Agentic AI, một giải pháp phần mềm full-stack được thiết kế nhằm giúp khách hàng đẩy nhanh việc triển khai và ứng dụng Agentic AI.

Ông Thomas Cornely, Phó Chủ tịch cấp cao phụ trách Quản lý Sản phẩm tại Nutanix, cho biết:

“Nutanix Agentic AI mở rộng các thành phần hiện có của chúng tôi như AHV hypervisor, Flow Virtual Networking, Nutanix Kubernetes Platform và Nutanix Enterprise AI để mang lại mô hình vận hành cloud cho các AI factory trong doanh nghiệp. Điều này giúp các đội hạ tầng và nền tảng có thể dễ dàng xây dựng, vận hành và quản trị AI factory, đồng thời cung cấp cho các nhà phát triển Agentic AI hiệu năng cao cùng hệ sinh thái mô hình và dịch vụ AI phong phú.”

Nutanix Agentic AI tích hợp với nền tảng NVIDIA AI Enterprise tại lớp Agent Builder, đồng thời điều phối hệ sinh thái AI factory đã được NVIDIA chứng nhận cho các cấu hình được hỗ trợ. Giải pháp này cho phép doanh nghiệp xây dựng, vận hành và bảo vệ các ứng dụng AI agentic thông qua bộ công cụ orchestration hạ tầng, bảo mật, cùng với các dịch vụ nền tảng AI (PaaS) và mô hình dạng dịch vụ (MaaS) dành cho data scientist và developer.

Chi tiết hơn:

Nutanix Enterprise AI (NAI) v2.6:

-

Bổ sung AI Gateway giúp quản lý chính sách tập trung cho cả LLM chạy trên cloud và on-prem

-

Hỗ trợ Model Context Protocol (MCP) và fine-tuning, mở rộng khả năng MaaS

-

Cho phép các agent kết nối an toàn với hệ thống và dữ liệu doanh nghiệp

-

Hỗ trợ các mô hình Nemotron mã nguồn mở, dataset và công cụ training

Nutanix Kubernetes Platform (NKP):

-

Mở rộng theo chuẩn CNCF với bộ công cụ AI mã nguồn mở

-

Bao gồm: notebooks, vector database, MLOps workflow engine và các framework agentic

-

Nhờ tích hợp NVIDIA AI Enterprise, developer có thể triển khai ngay các dịch vụ NVIDIA NIM, bao gồm Nemotron

Tối ưu hạ tầng:

-

AHV hypervisor được nâng cấp để tự động tối ưu phân bổ tài nguyên vật lý cho VM trên các server có mật độ GPU cao

-

Flow Virtual Networking hỗ trợ offload data plane sang DPU BlueField, giúp giảm tải CPU và bộ nhớ

Storage & Data Fabric:

-

Nutanix Unified Storage cung cấp hiệu năng đọc/ghi scale tuyến tính cho hàng nghìn GPU

-

Xây dựng data fabric độ trễ thấp, tối ưu hiệu quả GPU

-

Hỗ trợ offload KV Cache và các giao thức như S3 over RDMA, NFS over RDMA

Hiện tại, Nutanix Agentic AI bao gồm các thành phần đã sẵn sàng thương mại và một số tính năng đang trong giai đoạn early access, dự kiến sẽ sớm được phát hành rộng rãi.

Seagate: Đưa HDD trở lại cuộc chơi AI

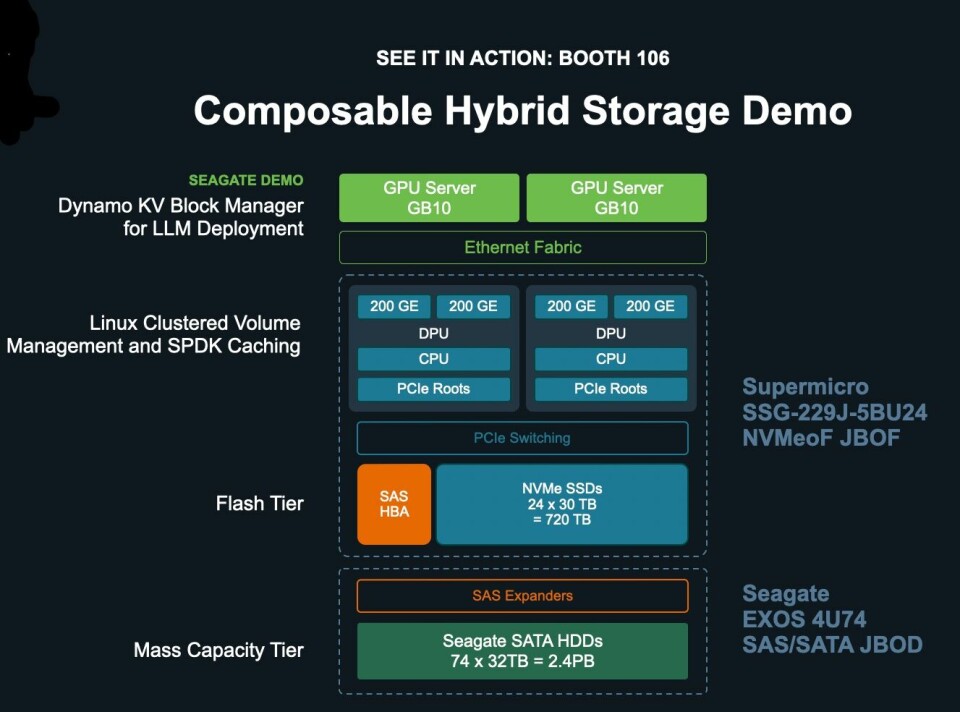

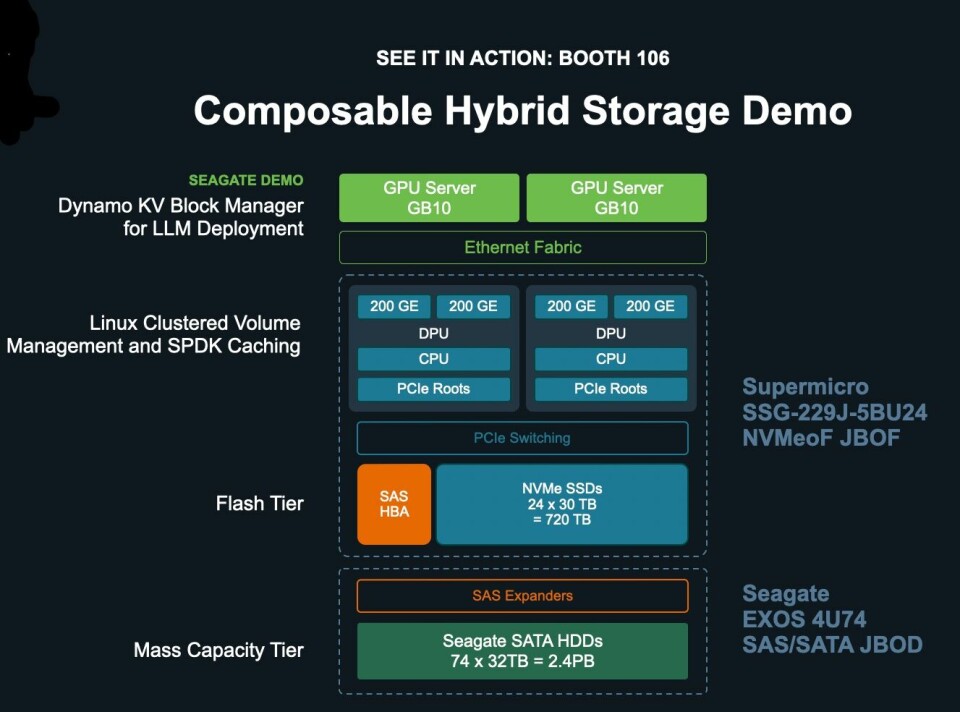

Seagate đã trình diễn giải pháp sử dụng hệ thống JBOD (Just a Box of Disks) làm backend cho một hệ thống SSD JBOF (Just a Box of Flash) mở rộng KV Cache do Supermicro cung cấp. Đồng thời, hãng cũng đề cập đến ý tưởng sử dụng ổ đĩa HDD truy cập qua NVMe, dù không nhấn mạnh như tại GTC 2025.

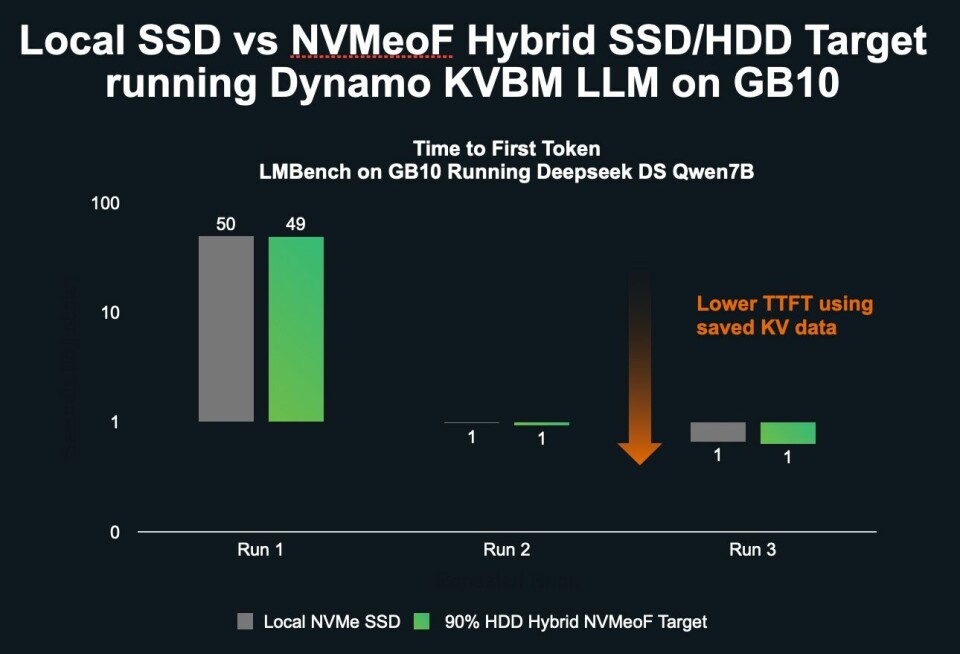

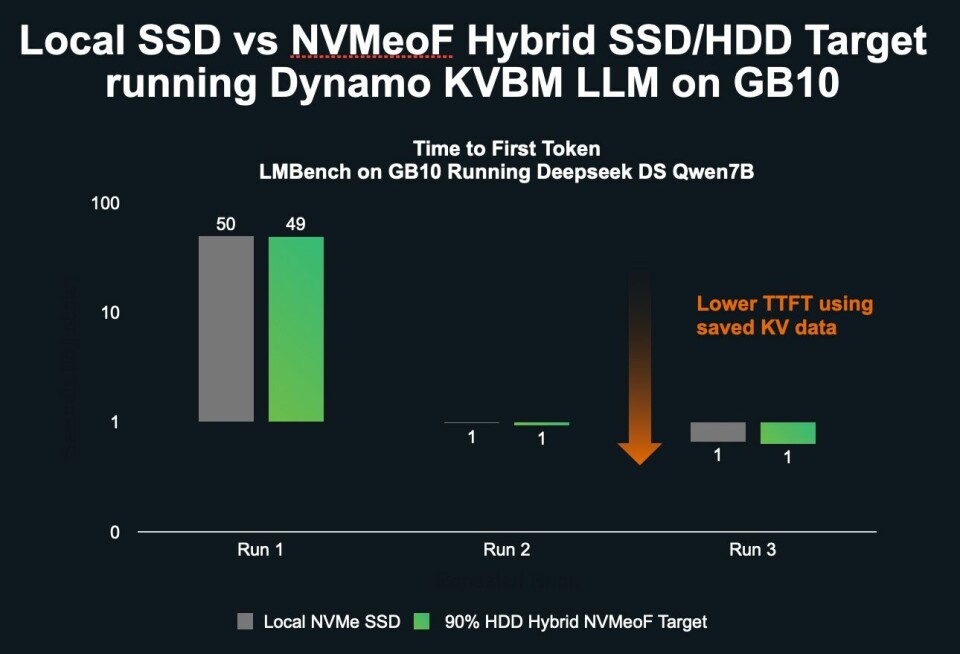

Demo KV Cache extension bao gồm:

-

Node GPU cluster NVIDIA GB10, sử dụng Dynamo KV Block Manager để triển khai LLM

-

Hai DPU BlueField-4 điều khiển NVMe-oF và cơ chế caching, kết hợp với Linux Clustered Volume Management và SPDK Caching, kết nối với GPU server qua Ethernet

-

Hệ thống Supermicro NVMe-oF JBOF đóng vai trò tầng cache SSD tốc độ cao, giữ dữ liệu “nóng” gần compute, kết nối với DPU qua PCIe, dung lượng 720TB (24 ổ NVMe SSD 32TB)

-

Hệ thống HDD JBOD Seagate Exos 4U74 kết nối SAS, cung cấp 2.4PB (74 ổ 32TB), tạo thành kiến trúc hybrid SSD/HDD qua NVMe-oF

Seagate hybrid SSD/HDD KV Cache extension diagram.

Ông Vik Malyala – Chủ tịch và Giám đốc Điều hành khu vực EMEA, đồng thời là Phó Chủ tịch cấp cao phụ trách Công nghệ và AI tại Supermicro – cho biết:

“Việc kết hợp tầng flash JBOF của Supermicro với tầng ổ cứng của Seagate có thể giúp giảm đáng kể chi phí inference trong khi vẫn đảm bảo hiệu năng cao.”

Vậy điều này hoạt động như thế nào?

Seagate và Supermicro cho rằng một kiến trúc AI hiệu quả cần tách biệt rõ giữa bộ nhớ ngắn hạn (flash) và bộ nhớ dài hạn (disk), đồng thời sử dụng mỗi tầng cho đúng mục đích của nó:

-

Tầng truy cập thời gian thực (real-time access):

Bao gồm bộ nhớ HBM của GPU, DRAM của CPU, cùng các SSD NVMe cục bộ hoặc qua mạng. Tầng này xử lý dữ liệu “tức thời” như các token đang hoạt động, embedding “nóng” và các dữ liệu được truy cập thường xuyên. -

Tầng lưu trữ dung lượng (capacity tier):

Được xây dựng từ ổ cứng HDD, dùng để lưu trữ dữ liệu dài hạn như dataset lớn, lịch sử dài và bộ nhớ mở rộng của các agent AI.

Dữ liệu sẽ được tự động phân bổ giữa các tầng, với sự điều phối của DPU nhằm quản lý việc di chuyển và caching. Nhờ đó, doanh nghiệp có thể giảm việc sử dụng flash đắt tiền, bởi ổ cứng HDD cung cấp chi phí trên mỗi GB thấp hơn đáng kể cho dữ liệu dài hạn.

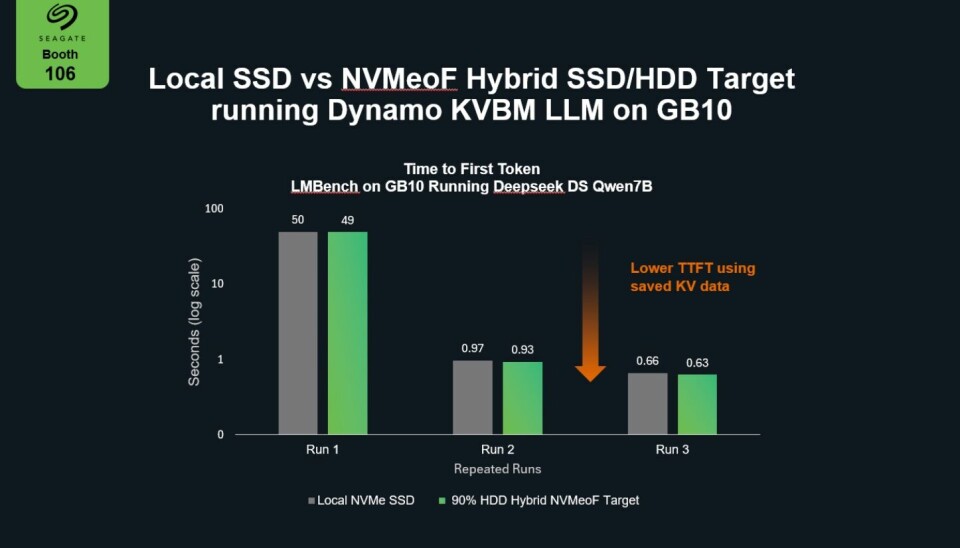

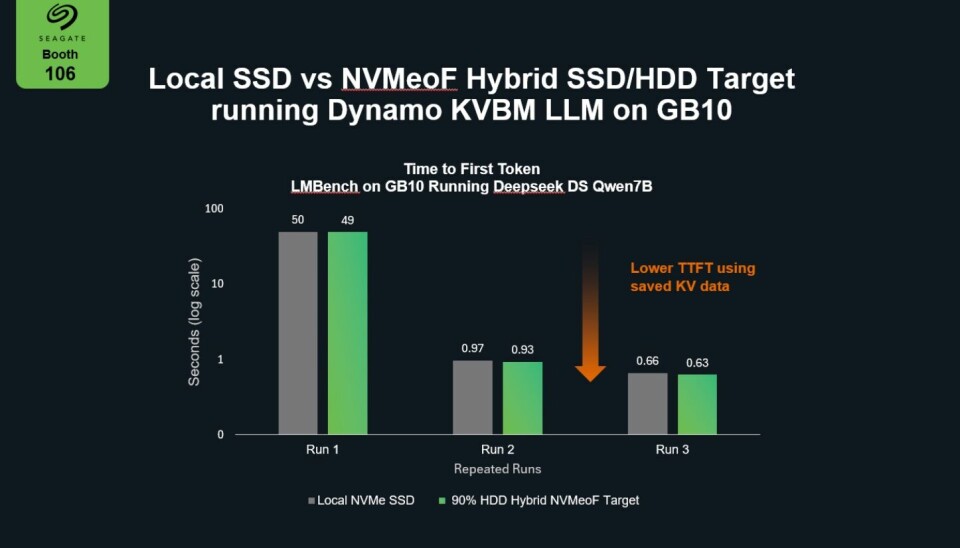

Một biểu đồ thử nghiệm cho thấy gần như không có sự khác biệt đáng kể về thời gian phản hồi (time to first token) giữa hệ thống cache hybrid SSD/HDD và hệ thống sử dụng SSD NVMe cục bộ.

Seagate hybrid SSD/HDD KV Cache concept trst result

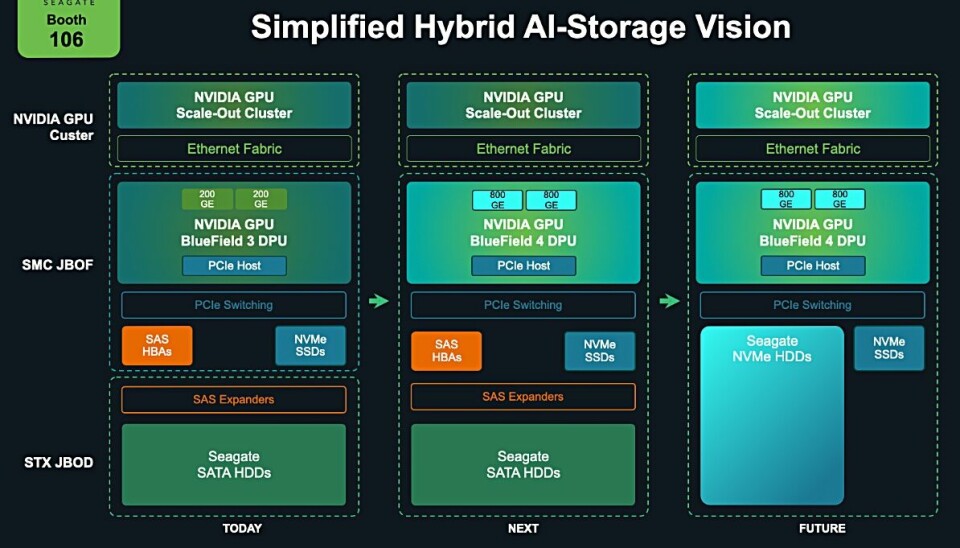

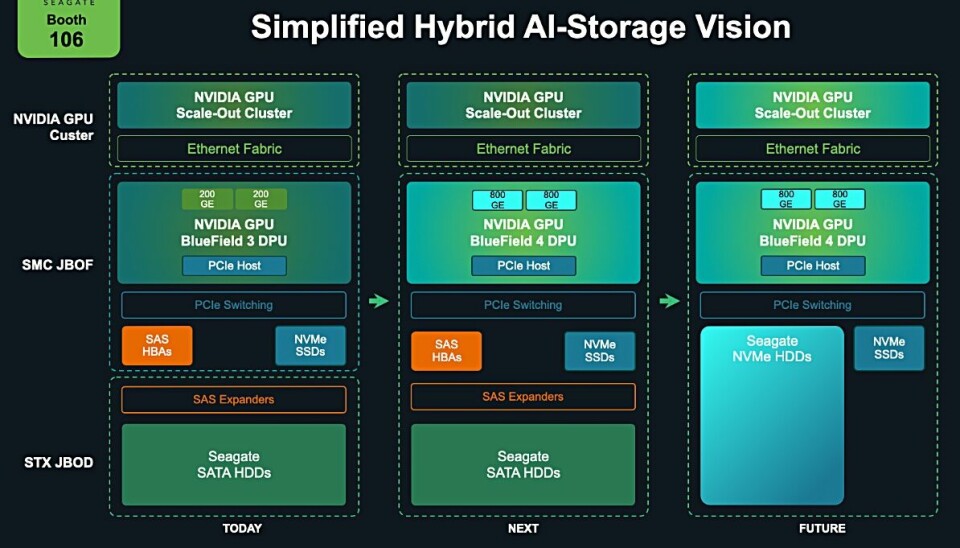

Seagate cũng cho biết kiến trúc này có thể mở rộng (scale-out) và dễ dàng nâng cấp thành phần. Lộ trình phát triển được thể hiện qua việc chuyển từ BlueField-3 lên BlueField-4 trong tương lai, cũng như từ ổ đĩa SATA sang các ổ HDD truy cập qua NVMe.

Seagate hybrid SSD/HDD KV Cache extension evolution.

Điều này khác với demo tại GTC 2025, khi Seagate sử dụng các ổ cứng NVMe dạng prototype. Ở thời điểm hiện tại, các ổ NVMe HDD này vẫn chưa thực sự cần thiết. Tuy nhiên, Seagate nhấn mạnh rằng trong tương lai, NVMe HDD có thể giúp loại bỏ nhu cầu sử dụng HBA, các bridge giao thức và hạ tầng SAS bổ sung, từ đó tạo ra một kiến trúc lưu trữ AI thống nhất dựa trên NVMe.

Hiện tại, đây vẫn chỉ là một bản demo và chưa có sản phẩm thương mại hoàn chỉnh kết hợp giữa JBOF, JBOD và DPU từ Seagate và Supermicro.

Tuy nhiên, nếu mô hình KV Cache extension trở nên phổ biến và giá NAND tiếp tục tăng cũng như nguồn cung khan hiếm, Seagate hoàn toàn có cơ hội đưa ổ cứng HDD quay trở lại thị trường AI. Đây là một hướng đi đáng ghi nhận.